在开放、高动态和演化环境中的学习能力是生物智能的核心要素之一,也是人类以及大多数动物在“适者生存”的自然选择过程中形成的重要优势。目前传统机器学习范式是在静态的和封闭的数据集上学习到一个模型,并假设其应用环境和之前训练数据的属性相同,因而无法适应动态开放环境的挑战。持续学习针对该问题,模拟生物智能的学习过程和学习能力,发展新型的机器学习理论和方法,通过持续学习的过程,以期提升智能体对开放、高动态环境的适应能力。但是,目前主流的机器学习模型通过调整网络参数进行学习,当学习任务的数据分布发生变化时,先前学到的网络参数可能被覆盖,从而导致对先前知识的灾难性遗忘(catastrophic forgetting)。

作为人工智能尤其是深度学习发展的重要瓶颈,持续学习近年来在人工智能领域受到广泛关注。大多数持续学习方法都专注于提高对所学知识的记忆稳定性以克服灾难性遗忘,例如在学习新任务时固定执行旧任务的网络参数。然而,这些方法通常只能在特定场景中发挥作用,难以像生物智能那样对现实世界的复杂环境和任务具有普遍的适应能力。能否借鉴生物脑的持续学习机理,发展新型的持续学习方法一直是人工智能领域普遍关注的问题。

图1.本研究获选12月封面文章

2023年11月16日,清华大学生命科学学院、清华-IDG/麦戈文脑科学研究院、清华-北大生命科学联合中心钟毅课题组联合清华大学计算机科学与技术系朱军课题组在自然机器智能(Nature Machine Intelligence)期刊发表了题为“在人工智能的持续学习中融入神经启发的适应性”(Incorporating neuro-inspired adaptability for continual learning in artificial intelligence)的研究论文,并被选作12月的封面文章。这项研究利用贝叶斯方法深入分析并建模了生物学习记忆系统的适应性机制,显著提升了深度神经网络的持续学习能力,为智能系统的自适应发展提供了跨学科的深刻见解。

随着大规模标注数据的出现和硬件设备计算能力的增强,以深度学习为核心的人工智能在计算机视觉、自然语言处理、自动驾驶、智能机器人等领域取得了一系列突破性进展。然而,深度学习高度依赖于静态的数据分布,难以对动态变化的数据分布进行持续学习。

从理论层面来看,持续学习的优化目标可以被进一步细化为记忆稳定性、学习可塑性、泛化兼容性等核心要素。为了适应不断变化的环境和任务,智能系统需要在记忆旧知识和学习新知识之间取得适当的平衡,并具备充分的泛化能力以容纳数据分布之间的差异。

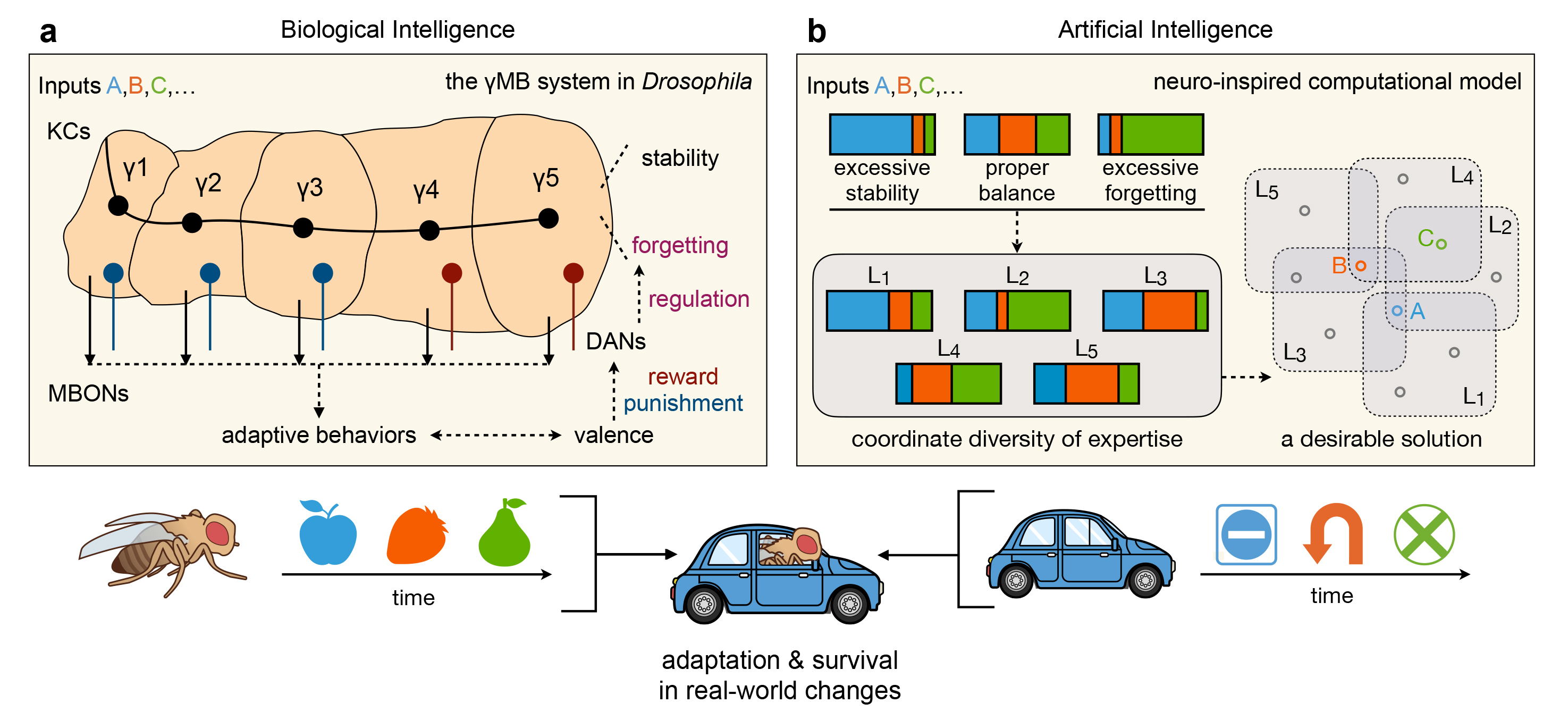

图2 .生物智能启发的持续学习方法

作为天然的模板,人类以及大多数动物天生就是以一种持续不断的方式进行学习的。即使是果蝇等简单的生命体,也进化出了多种适应性机制,以实现有效的持续学习。在果蝇的学习记忆系统中,动态变化的记忆可以在多个并行的持续学习模块中被有选择地保护和遗忘,为人工智能提供了重要的启示。

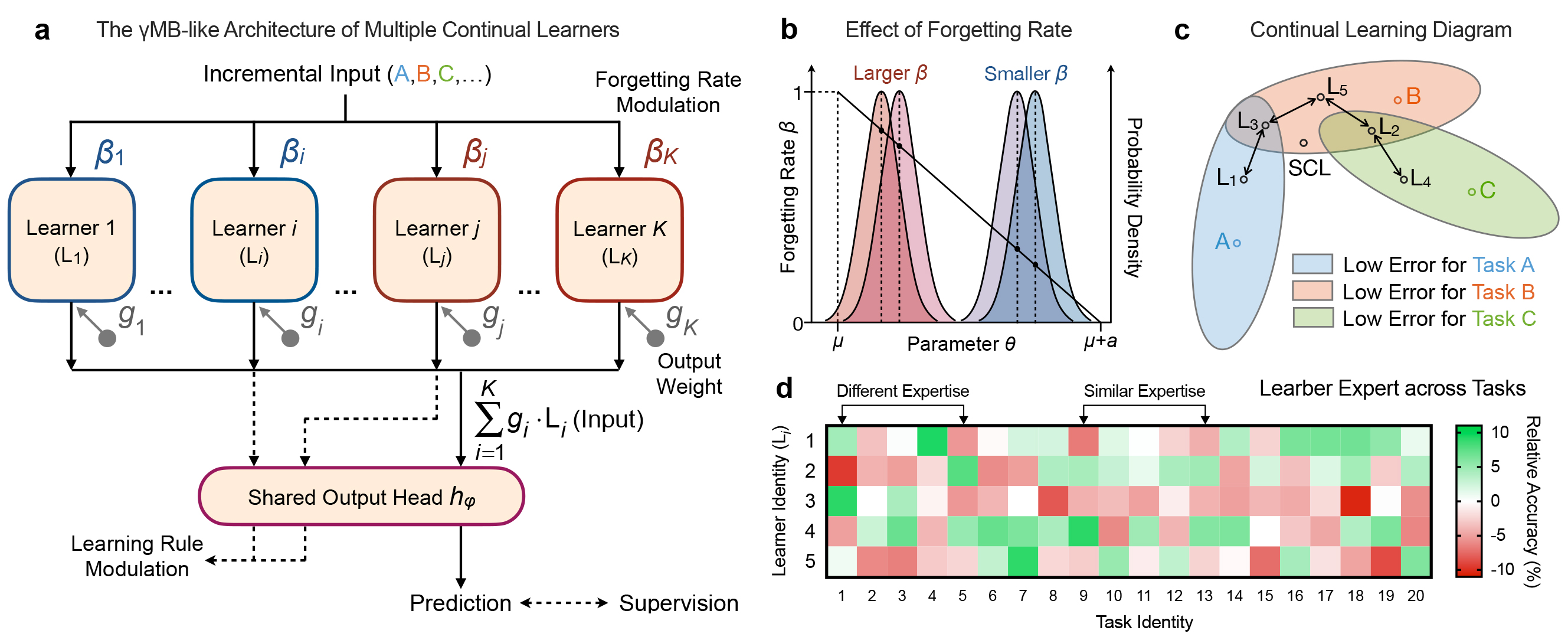

图3.记忆的选择性保护与遗忘机制

在方法层面,研究人员提出了一种生物启发的记忆调控方法,对所学知识进行有选择地保护和遗忘。在学习新任务时,该方法通过优化参数分布中的旧任务信息来促进记忆稳定性,并引入一定程度的遗忘率以促进学习可塑性。同时,研究人员构建了一种类似果蝇学习记忆系统的并行多模块结构,通过对记忆进行有选择的保护和遗忘,使各个模块分化出适当的任务专长,从而适应不同任务的数据分布差异。

图4.动态调节的并行多模块结构

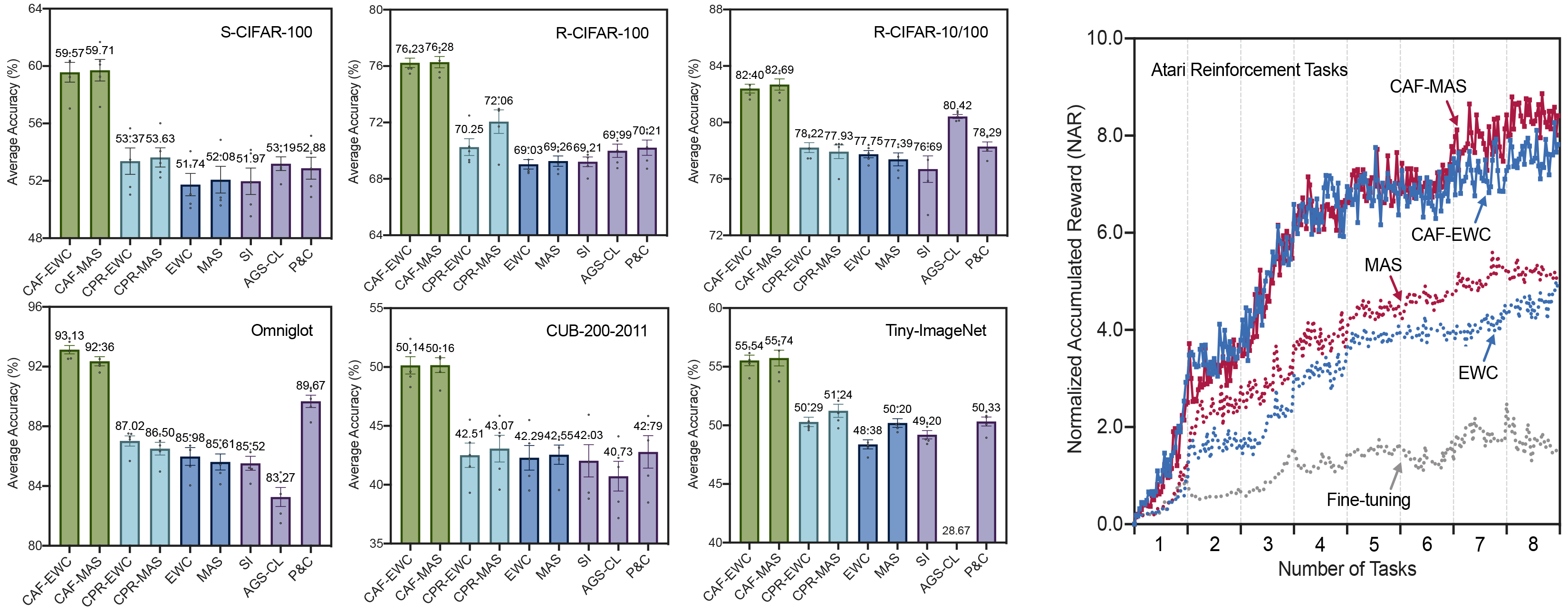

在多种持续学习基准中,包括视觉任务和强化任务等,所提出的适应性机制能够显著提高深度神经网络的持续学习能力。此外,论文还从遗忘的生物学意义和实现机制等角度,深入探讨了智能系统在持续学习方面的联系,作为一种新的范式推动人工智能和生物智能的协同发展。

图5. 多种持续学习基准的实验结果

清华大学生命学院、清华-IDG/麦戈文脑科学研究院钟毅教授和计算机系的朱军教授为本论文的共同通讯作者,生命学院已毕业博士生王立元与计算机系的博士后张幸幸为本论文的共同第一作者。清华大学生命学院的李乾助理研究员、计算机系的苏航副研究员、以及伦敦大学学院人工智能中心的张鸣天博士是本论文的共同作者。该研究得到了国家重点研发计划、国家自然科学基金委面上项目、清华-北大联合中心、清华国强研究院、清华高性能计算中心、新基石科学基金会的经费资助。

|

原文链接:https://www.nature.com/natmachintell/volumes/5/issues/12 |